Notice

Recent Posts

Recent Comments

Link

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

Tags

- neural networks #linear #nonlinear #perceptrons

- evaluation

- 1x1 convolution

- flops

- 대학원생

- 네이버

- AI tech

- recall

- momentum #adagrad #adam #early stopping #data augmentation #dropout #label smoothing #batch normalization

- map

- objectdetection

- FPS

- confusion matrix

- Optimization

- 부트캠프

- precision

- deep learning #machine learning #history

- CNN #padding #stride #parameters

- IOU

- 일상

- generalization #overfitting # bootstrapping #bagging #boosting #stochastic gradient desent #mini-batch gradient descent #batch gradient descent

Archives

- Today

- Total

목록CNN #padding #stride #parameters (1)

공부 일기장

Convolutional Neural Networks

Convolutional Neural Networks

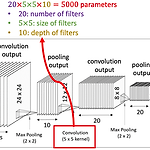

CNN [필수 개념] filter & channel stride padding pooling CNN의 기초적인 형태 가장 중요한 건 파라미터 수를 계산할 줄 알아한다. layer별로 또는 전체의 파라미터가 어느정도인지 감을 가지고 있는 것이 매우 중요 최근에 FC layer를 최대한 줄이는 추세임 (파라미터를 실제로 손으로 계산해보는 연습 또한 필요함) Stride Padding Parmeters Calculate stride 1, padding 1인 경우 다음의 파라미터 수는 (3*3*128)*64 = 73,728 1 X 1 Convolution 영역을 보지는 않고 한 pixel만을 본다. 그럼에도 사용하는 이유는? dimension reduction increasing depth reduce numb..